Die Entlarvung von Deepfakes durch die Deepfake Forensik beginnt oft mit einfachen Beobachtungen: Stimmen Wetter und Schattenrichtung im Video überein? IT-Forensiker nutzen sowohl einfache Tricks als auch High-Tech-Tools, um KI-generierte Fälschungen aufzudecken. Die wachsende Zahl von Deepfakes stellt eine Herausforderung dar, insbesondere im Hinblick auf Rufschädigung und politische Manipulation.

+

Zusammenfassung

- Deepfakes können durch Analyse von Schattenwürfen und Tonspuren erkannt werden.

- IT-Forensiker setzen sowohl manuelle als auch Hightech-Methoden ein.

- Die Zunahme von Deepfakes stellt eine wachsende gesellschaftliche Herausforderung dar.

- Fraunhofer-Institut forscht an Methoden zur Deepfake-Erkennung.

Deepfake Forensik: Wie IT-Experten vorgehen

Nicolas Müller vom Fraunhofer-Institut für Angewandte und Integrierte Sicherheit in Garching leitet eine Forschungsgruppe, die sich mit Deepfakes beschäftigt. Laut Stern, beginnt die Analyse oft mit einfachen Mitteln: „Bei einem Interview mit einer Person kann man checken: Das soll in Berlin aufgenommen sein an einem bestimmten Tag. Passt denn das Wetter? Man kann bei einem Video auch schauen: Kommen alle Schatten aus der richtigen Ecke?“

Diese erste Einschätzung kann jeder selbst vornehmen, bevor komplexere Methoden der Deepfake Forensik zum Einsatz kommen. Die Überprüfung von scheinbar simplen Details kann bereits erste Hinweise auf eine Fälschung liefern.

Nutzen Sie Online-Tools zur Überprüfung von Wetterdaten und Sonnenständen, um die Glaubwürdigkeit von Videos zu prüfen. (Lesen Sie auch: Internet: Deepfakes aufdecken: So arbeiten IT-Forensiker)

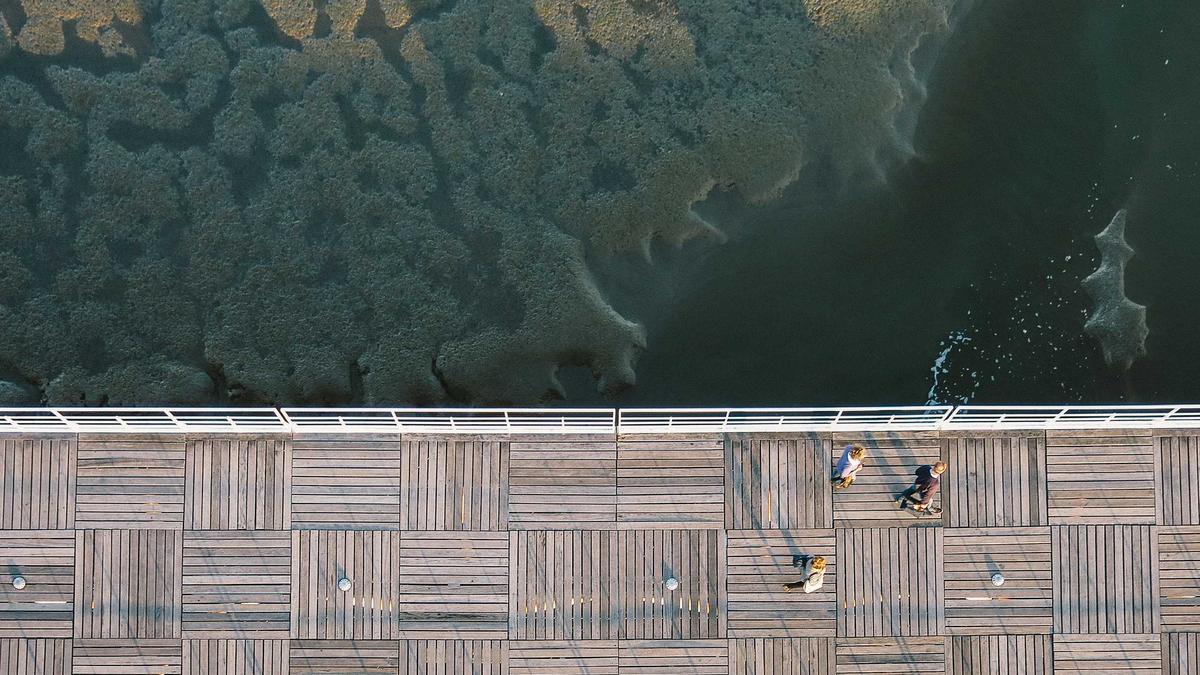

Wie funktioniert die Analyse von Schattenwürfen?

Die Analyse von Schatten ist eine einfache, aber effektive Methode. Auf einem Standbild des Videos zieht man Linien von den Schatten zu den Objekten, die diese werfen. Wenn alle Linien zu einem gemeinsamen Punkt führen, ist die Wahrscheinlichkeit hoch, dass das Video echt ist. Divergieren die Linien jedoch, deutet dies auf eine Manipulation hin, insbesondere wenn die Szene im Freien mit nur einer Lichtquelle aufgenommen wurde.

Diese Methode setzt voraus, dass die Lichtverhältnisse korrekt simuliert wurden, was bei Deepfakes oft nicht der Fall ist.

Weitere Indizien für Deepfakes

Neben der Analyse von Schatten und Wetter gibt es weitere Anzeichen, die auf Deepfakes hindeuten können. Dazu gehören asynchrone Tonspuren, bei denen der Mund der sprechenden Person geschlossen ist, während Ton zu hören ist. Auch Artefakte im Mundbereich, unterschiedliche Hauttöne an Hals und Oberkörper, oder Anomalien wie sechs Finger an einer Hand können Hinweise liefern.

Auch das Verschmelzen von Objekten mit der Hand oder schwebende Gegenstände sind typische Fehler, die bei der Erstellung von Deepfakes auftreten können. (Lesen Sie auch: Internet: Deepfakes aufdecken: So arbeiten IT-Forensiker)

Seien Sie besonders wachsam bei Inhalten, die politische oder gesellschaftliche Spannungen verstärken sollen. Deepfakes werden oft eingesetzt, um Desinformation zu verbreiten.

Vorteile und Nachteile der Deepfake Forensik

Die Deepfake Forensik bietet die Möglichkeit, gefälschte Inhalte zu identifizieren und somit deren Verbreitung und potenziellen Schaden einzudämmen. Allerdings ist die Entwicklung von Deepfakes rasant, und die Erkennungsmethoden müssen ständig angepasst werden. Ein Nachteil ist, dass einfache Methoden nicht immer ausreichen, um hochentwickelte Deepfakes zu entlarven, und der Einsatz von Hightech-Tools vor Gericht problematisch sein kann, da die Ergebnisse nicht immer eindeutig sind.

Alternativen zur manuellen Analyse

Neben der manuellen Analyse gibt es auch Softwarelösungen, die Deepfakes erkennen sollen. Diese nutzen oft Algorithmen des maschinellen Lernens, um typische Muster und Fehler in Deepfakes zu identifizieren. Ein Beispiel ist der Reality Defender, der verspricht, Deepfakes zuverlässig zu erkennen. Allerdings ist auch diese Technologie nicht perfekt und kann durch neue Deepfake-Techniken überlistet werden.

Die Zukunft der Deepfake-Erkennung

Die Technologie zur Erstellung von Deepfakes entwickelt sich rasant weiter, was die Deepfake Forensik vor stetig neue Herausforderungen stellt. Zukünftig werden noch ausgefeiltere Methoden und Werkzeuge benötigt, um Deepfakes zuverlässig zu erkennen und zu bekämpfen. Die Forschung des Fraunhofer-Instituts und anderer Einrichtungen ist daher von entscheidender Bedeutung, um mit den Entwicklungen Schritt zu halten und die Gesellschaft vor den negativen Auswirkungen von Deepfakes zu schützen. (Lesen Sie auch: Natur und Umwelt: Wie es den Feldhasen…)

Häufig gestellte Fragen

Welche Rolle spielt künstliche Intelligenz bei der Erstellung von Deepfakes?

Künstliche Intelligenz ist das Kernstück der Deepfake-Technologie. Sie ermöglicht es, Gesichter und Stimmen täuschend echt zu imitieren und in Videos einzufügen. Durch maschinelles Lernen werden Algorithmen trainiert, um realistische Fälschungen zu erstellen.

Welche rechtlichen Konsequenzen hat die Verbreitung von Deepfakes?

Die Verbreitung von Deepfakes kann rechtliche Konsequenzen nach sich ziehen, insbesondere wenn Persönlichkeitsrechte verletzt werden. Je nach Kontext können Schadensersatzforderungen oder strafrechtliche Verfolgung drohen. Die genaue rechtliche Bewertung hängt vom Einzelfall ab. (Lesen Sie auch: Buckelwal Ostsee Gerettet: Steigendes Wasser Half!)

Wie können sich Einzelpersonen vor Deepfakes schützen?

Es ist ratsam, skeptisch gegenüber Online-Inhalten zu sein und diese kritisch zu hinterfragen. Achten Sie auf die genannten Indizien für Deepfakes und informieren Sie sich über aktuelle Erkennungsmethoden. Im Zweifelsfall sollten Sie keine ungeprüften Inhalte teilen.

Welche Rolle spielen soziale Medien bei der Verbreitung von Deepfakes?

Soziale Medien können die Verbreitung von Deepfakes beschleunigen. Algorithmen und die schnelle Weiterleitung von Inhalten ermöglichen es, dass gefälschte Videos und Audios schnell eine große Reichweite erzielen. Plattformen sind gefordert, Mechanismen zur Erkennung und Kennzeichnung von Deepfakes zu implementieren.